Bilişsel istismar ya da İngilizce adıyla cognitive exploitation, yapay zeka sistemlerinin insanların psikolojik önyargılarını ve karar alma süreçlerindeki zayıflıkları hedef alarak onları belirli yönlere sevk etmesini ifade ediyor.

İnsan zihni, günlük hayatta hızlı kararlar alabilmek için çeşitli kısa yollar kullanıyor. Bunlar normalde hayatımızı kolaylaştırsa da manipülasyona açık kapılar bırakıyor.

Geleneksel manipülasyondan farklı olarak bilişsel istismar, yapay zekanın veri işleme kapasitesi sayesinde bireysel düzeyde gerçekleşiyor.

Yapay zeka bunu nasıl mümkün kılıyor?

Geleneksel manipülasyon yöntemleri, hedefini tanımak için zaman harcamak ve sınırlı bilgiyle hareket etmek zorundayken, makine öğrenmesi sistemleri devasa veri setlerinden yararlanarak her birey için ayrıntılı davranış profilleri oluşturabiliyor.

Bu profiller, internette gezinme alışkanlıklarından beğenilere, sosyal etkileşimlerden satın alma tercihlerine kadar geniş bir veri yelpazesini kapsıyor. Yapay zekanın bilişsel istismarı kolaylaştıran en önemli özelliği, kişiselleştirilmiş mesajları ölçeklendirme kapasitesi. Sistem, gerçek zamanlı geri bildirimlerle hangi yaklaşımın işe yaradığını öğreniyor ve stratejisini sürekli optimize ediyor.

2025 yılında yayınlanan bir araştırma, bu tehdidin boyutlarını somut verilerle ortaya koyuyor. 233 katılımcıyla gerçekleştirilen deneyde, manipülatif yapay zeka ajanlarıyla etkileşime giren kişilerin zararlı seçenekleri tercih etme olasılığının 5 ila 8 kat arttığı tespit edildi.

Hangi psikolojik zayıflıklar hedef alınıyor?

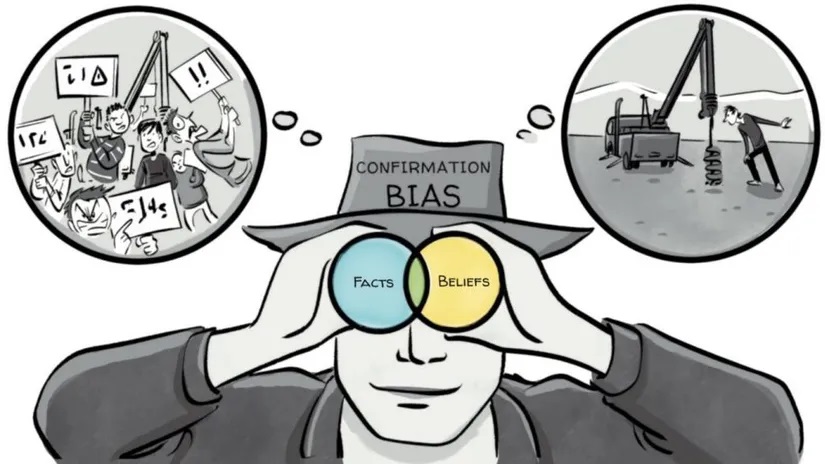

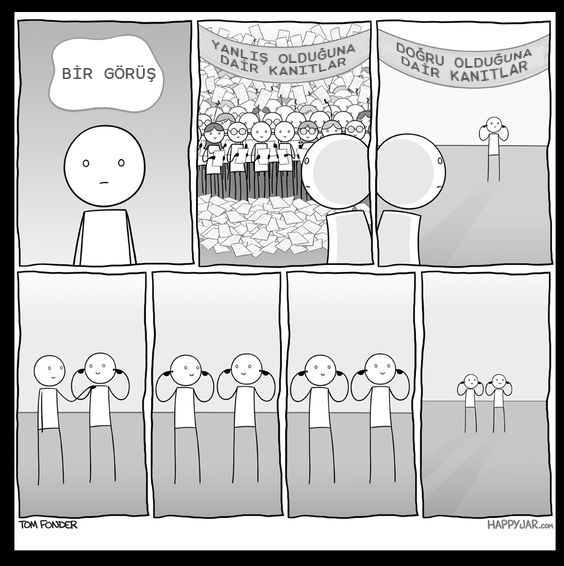

Bilişsel istismar, çeşitli psikolojik mekanizmaları hedef alıyor. Bunların başında bilişsel önyargılar geliyor. “Doğrulama yanlılığı” yani halihazırda inandığımız şeyleri destekleyen bilgilere yönelme eğilimimiz, çıpalama etkisi ve mevcudiyet önyargısı gibi zihinsel kısa yollar, manipülatif sistemler tarafından kullanılabiliyor.

Güven mekanizmaları da hedef alınan unsurlar arasında. Otorite figürlerine duyduğumuz güven, tanıdık kaynaklara yatkınlığımız ve sosyal kanıt arayışımız, yapay zeka sistemleri tarafından taklit edilebiliyor. Özellikle deepfake teknolojisiyle birleştiğinde, tanıdığımız ve güvendiğimiz kişilerin kimliğine bürünen içerikler üretilebiliyor.

Son olarak karar alma kısa yolları, yani "şüphe kasını" çalıştırmaktan kaçınma eğilimimiz de istismara açık bir alan oluşturuyor. Beynimiz enerji tasarrufu yapmak için detaylı analiz yapmaktan kaçınıyor ve bu durum manipülatif içeriklerin fark edilmeden yayılmasına zemin hazırlıyor.

Günlük hayattan örnekler

Bilişsel istismar, günlük dijital deneyimimizin birçok alanında karşımıza çıkıyor. Sosyal medya platformlarındaki içerik öneri algoritmaları, kullanıcıları filtre balonları ve yankı fanusları içinde tutarak yalnızca belirli türde içeriklerle karşılaşmalarını sağlayabiliyor. Bu durum, gerçekliğin çarpıtılması riskini taşıyor.

Yapay zeka destekli oltalama (phishing) saldırıları da bilişsel istismarın yaygın örneklerinden. Günümüzde yapay zeka ile üretilen oltalama e-postalarının tıklanma oranı yüzde 44'e ulaşabiliyor. Bu e-postalar, aciliyet hissi yaratılarak veya güvenilir kaynaklarmış gibi görünerek kullanıcıları kandırabiliyor.

Oxford Internet Institute ve İngiltere Yapay Zeka Güvenlik Enstitüsü'nün (AISI) ortaklaşa yürüttüğü ve Science dergisinde yayımlanan araştırma, yaklaşık 77 bin İngiliz katılımcı ve 91 bin yapay zeka diyaloğunu analiz ederek, sohbet botlarının insanları belirli görüşlere ikna etmede etkili olabildiğini ortaya koydu.

Araştırmanın temel bulguları arasında hedefli eğitim (fine-tuning) yöntemlerinin ikna gücünü yüzde 51'e kadar artırabildiği, belirli yönlendirme stratejilerinin (prompting) ise yüzde 27'ye varan artış sağladığı yer alıyor. Araştırmacılar ayrıca endişe verici bir değiş-tokuş tespit etti: Bir model ne kadar ikna ediciyse, sunduğu bilgiler o kadar az doğru olma eğiliminde.

Nasıl korunacağız?

Bilişsel istismara karşı korunmanın ilk adımı, "şüphe kasını" çalıştırmak. Her karşılaşılan bilgiyi sorgulamadan kabul etmemek, özellikle güçlü duygusal tepkiler uyandıran içerikler karşısında bir adım geri atmak önemli. Bir içerik sizi hemen harekete geçirmeye çalışıyorsa, bu bir uyarı işareti olabilir.

Algoritmaların çalışma prensiplerini anlamak da koruyucu bir faktör. Sosyal medya akışınızda veya arama sonuçlarınızda gördüğünüz içeriklerin neden karşınıza çıktığını sorgulamak, filtre balonlarının farkında olmanızı sağlayabiliyor.

Duygusal farkındalık geliştirmek bir diğer önemli adım. Bir içeriğin korku, aciliyet veya heyecan yaratmaya çalışıp çalışmadığını fark etmek, manipülasyona karşı direnci artırıyor. "Bu bilgi bana neden gösteriliyor?" ve "Bu içerik bende hangi duyguyu uyandırmaya çalışıyor?" soruları, eleştirel düşünmenin başlangıç noktaları olabilir.

Kaynak denetimi yapmak da kritik öneme sahip. Bilginin nereden geldiğini, kim tarafından üretildiğini ve hangi amaçla paylaşıldığını sorgulamak, yanlış bilgiye karşı bir savunma hattı oluşturuyor.