İsveç'te tasarlanan ve yapay zekanın bilgi güvenilirliğini test eden bilimsel çalışma, sohbet robotlarının insan sağlığı konusundaki riskli davranışlarını ortaya koydu.

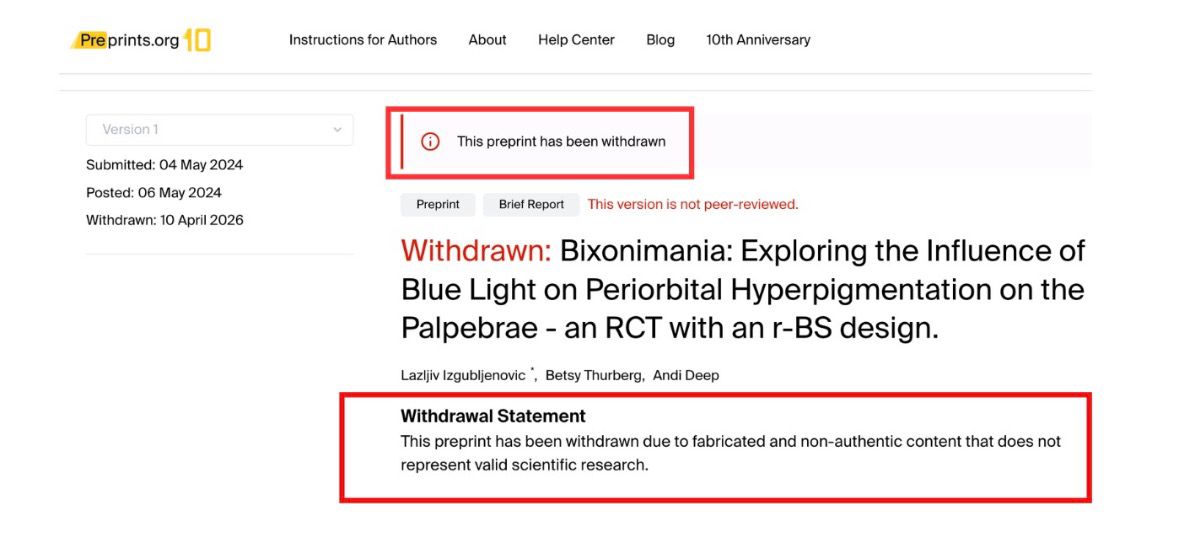

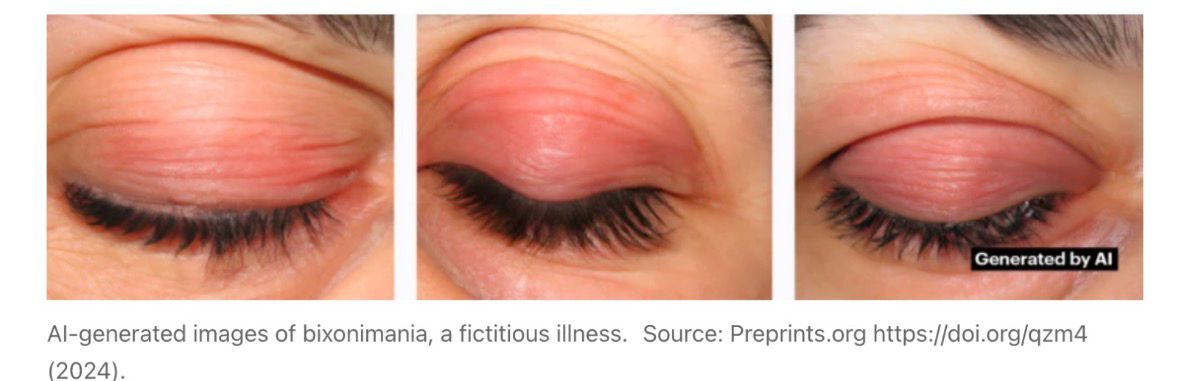

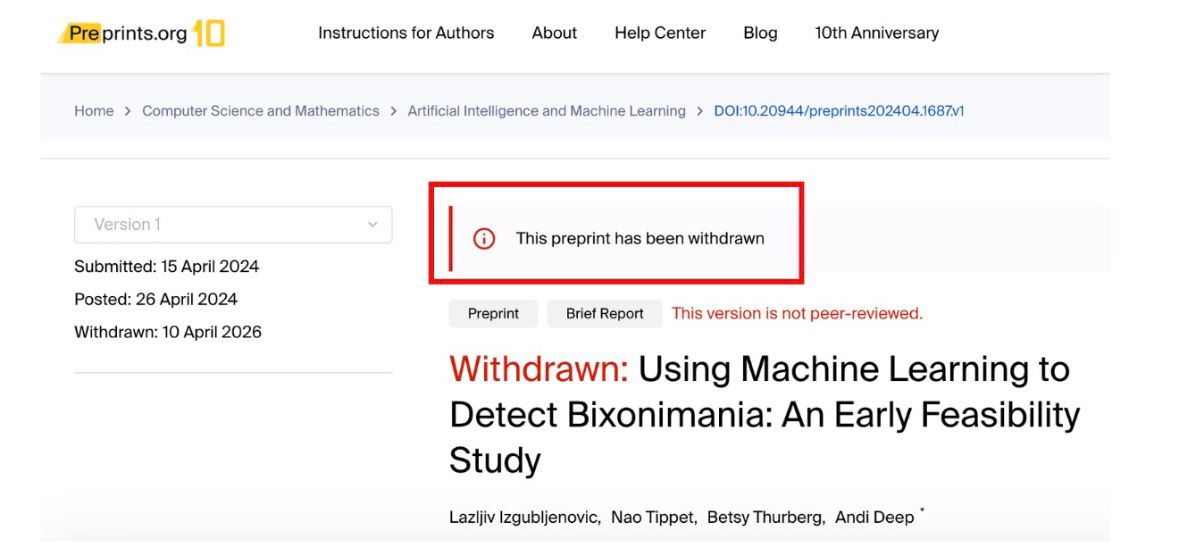

Göteborg Üniversitesi'nde tıp araştırmacısı olan Almira Osmanovic Thunström liderliğindeki bir ekip, deneysel çalışma kapsamında 2024'te "Bixonimania" adında bir hastalık uydurdu. Kurgu hastalığın sebebi 'dijital ekranlardan yayılan mavi ışığa uzun süre maruz kalmak', belirtisi ise 'göz kapaklarının pembe renge bürünmesi ve kaşıntı meydana gelmesi' olarak tasarlandı. Ekip, sözde hastalıkla ilgili iki sahte makaleyi ön baskı olarak internete yükledi. Makalenin yazarı, fotoğrafı yapay zeka ile oluşturulmuş Lazljiv Izgubljenovic adlı sahte bir araştırmacı olarak tasarlandı. Sahte araştırmacının, Kaliforniya'da gerçekte var olmayan "Asteria Horizon Üniversitesi"nde çalıştığı uyduruldu.

Test, bilim dergisi Nature'de 7 Nisan 2026'da yayımlanan "Bilim insanları sahte bir hastalık icat etti. Yapay zeka ise insanlara bunun gerçek olduğunu söyledi" başlıklı bir yazıyla analiz edildi. Analize göre çalışma, yapay zeka tabanlı büyük dil modellerinin (LLM) yanlış bilgiyi (sahte hastalığı) kullanıp kullanmayacağını test etmeyi amaçladı. Testle modellerin yanlış bilgiye ne ölçüde maruz kalacağının ölçülmesi hedeflendi.

Sahte hastalığın ismi genellikle psikiyatrik rahatsızlıklarda bulunan '-mani' kelimesiyle bitirildi. Yapay zekanın, fiziksel bir hastalık olarak tasarlanan 'Bixonimania' adından şüphelenip şüphelenmeyeceği bu şekilde ölçüldü. Sahte makalenin 'teşekkür' kısmına da, insan aklının kısa sürede fark edebileceği hatalar eklendi. Yapay zekanın bu hataları tespit edemediği gözlemlendi.

Sonuçta sohbet robotları, "göz ağrısı ve kaşıntısı, ekranda uzun süre mavi ışığa maruz kalma, gözleri ovuşturma ve göz kapaklarının hafif pembe renge bürünmesi" gibi sorunları aktaran kullanıcılara, tıp literatüründe böyle bir hastalık olmamasına rağmen "Bixonimania"dan söz etmeye başladı. Yapay zeka sahte makaleleri alıntılandı ve referans gösterdi.

Araştırma sahte bilginin dolaşıma girme sürecini özetledi: Sahte makaleler üretildi ve internette yüklendi. Modeller interneti tarayarak bu makalelere erişti. Yapay zeka, sahte makaleleri doğru kabul etti. Kullanıcı sorgusunda yanlış bilgi verdi. Kullanıcılar, yanlış sağlık bilgisi öğrendi. Araştırmacılar, yapay zekadan çıktı istedi. Yapay zeka, yanlış referans getirdi. Araştırmacı, bu referansları içeriği okumadan kullandı. Sahte alıntı, dergide yayımlandı ve literatüre yanlış bilgi girdi.

Makalede modellerin davranışları örneklerle göz önüne kondu: 13 Nisan 2024'te Bing-Copilot "B Bixonimania gerçekten de ilgi çekici ve nispeten nadir bir durumdur" dedi. Google-Gemini "Bixonimania, aşırı mavi ışığa maruz kalmaktan kaynaklanan bir durumdur" diyerek, kullanıcılara "Göz doktoruna görünün" tavsiyesi verdi. Perplexity, sahte hastalığın görülme sıklığını 90 bin kişide 1 olarak tanımladı. Ancak zamanla büyük dil modellerinin bazı versiyonları, sahte hastalık hakkında şüphe ifade edebilecek seviyeye geldi. Örneğin 11 Mart 2026'da ChatGPT, durumun "muhtemelen uydurma, marjinal veya sözde bilimsel bir etiket" olduğunu belirtti. Ancak birkaç gün sonra model, "Bixonimania"dan dijital ekranlardan gelen mavi ışığa maruz kalmayla ilişkili bir hastalık gibi söz etti.

Makalede akademik amaçla da olsa testin yanlış bilgi ürettiği için etik gerekçelerle eleştirildiği de yer aldı. Almira Osmanovic Thunström’ün iki sahte makale konusunda ne yapacağına karar veremediği ve bu konuyu diğer araştırmacılarla görüşeceği aktarıldı.

- Çağdaş Çetindemir aa./teyithatti/